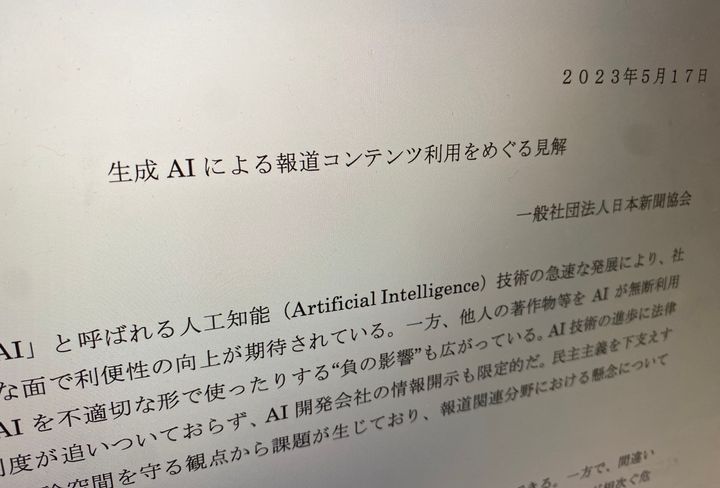

日本新聞協会(東京)は5月17日、人工知能の一種「生成AI」に対する見解を発表した。

AIが他人の著作物を無断利用したり、不適切な形で使ったりする「負の影響」が広がっているとし、健全な言論空間を守る観点から課題が生じていると指摘した。

生成AIとは?

産総研マガジンによると、生成AIとは「コンテンツやモノについてデータから学習し、それを使用して創造的かつ現実的な、まったく新しいアウトプットを生み出す機械学習手法」のこと。

このタイプのAIは、文章・画像などを学習を元に生成することができる。有名なのは、質問を元に文章をつくることができるOpenAI社の「ChatGPT」だ。

言論空間の混乱が進めば社会の混乱を招く

日本新聞協会はまず、生成AIは間違いや不正確な情報を含むことが多く、「事実と異なる AIの回答を信じるユーザーが相次ぐ危険性がある」とした。

事実関係が不確かな記事がネット上に大量に出回り、検索結果の上位を占める現象を助長する懸念があるとし、「このような『言論空間の混乱』が進めば社会の動揺を招く。民主主義を守る意味でも看過できない」とした。

個人情報保護上の懸念としては、AIを開発・提供する企業が情報の取り扱いに不可欠な倫理や責任を十分に考慮せず、ネット上の情報を無断・無秩序に利用するサービスを提供することで、個人情報保護法制が骨抜きになる点をあげた。

その上で、「 現行の日本の個人情報保護法は、要配慮個人情報を AI が回答した場合の適用について十分に整理されていない」と指摘した。

報道コンテンツが無断・無秩序に

また、日本では2018 年に著作権法が改正され、AIなどの開発過程で既存の著作物を無許諾で収集・利用することが原則として合法になったことについても言及。

当時は生成AIの負の影響が十分に想定されていたわけではなく、国会で大きな議論とならないまま、AI 開発を優遇する法改正が実現したことに懸念点があるとした。

このほか、報道コンテンツが無断・無秩序にAIに利用される可能性や、AIによる報道コンテンツの利用実体がブラックボックスでわからないことに関して危機感を示している。

国民の「知る権利」を阻害しかねない

日本新聞協会は「AIによる報道コンテンツの無断・無秩序な利用が既成事実化すれ ば、報道機関の経営に大きな打撃を与え、良質なニュースコンテンツを提供し続けることが困難になる可能性がある」と指摘。

良質なニュースコンテンツが減れば、国民の「知る権利」を阻害しかねないとし、政府に「著作権法や個人情報保護法を含めた法制度全体の観点から、生成AIが社会と調和するものとなるよう、制度的対応を急ぐべきである」と要望した。