7月25日、JR東日本は、利用者に無断でSuicaの利用履歴を日立に販売していたことについて、謝罪した。希望者は販売対象のデータから除外する措置を取るが、販売自体は今後も継続する。利用者に無断で販売されていたことや、「気持ち悪い」といった不快感が批判の引き金となった。

企業によるビッグデータの活用と、利用者のプライバシー意識。ビッグデータ時代のプライバシーについてまとめたい。

■個人情報保護法だけではビッグデータに対応できない

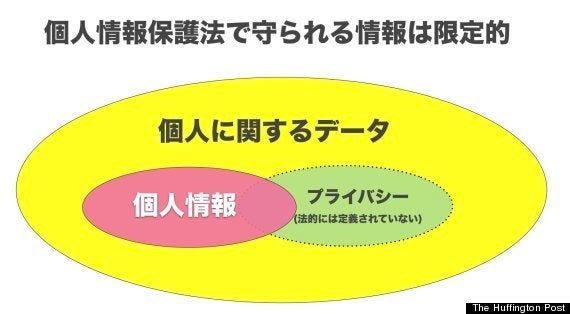

スマホやICカード、ネットサービスによって収集された、位置情報、投稿情報、利用履歴など個人にまつわる様々なデータの活用を考える際、まず個人に関わる情報のうち、どこまでが法律の保護対象なのかについて押さえておく必要がある。

個人情報保護法では個人情報を以下のように定義している。ポイントは「特定の個人を識別」できるかにある。

この法律において「個人情報」とは、生存する個人に関する情報であって、当該情報に含まれる氏名、生年月日その他の記述等により特定の個人を識別することができるもの(他の情報と容易に照合することができ、それにより特定の個人を識別することができることとなるものを含む。)をいう。

(「個人情報の保護に関する法律」より。 2009/05/30)

JR東日本は、この法律にしたがって「特定の個人を識別」できないよう加工するため問題ない、と判断して販売に踏み切った。

弁護士の見解でも、抽象化した購買データは個人情報にあたらないとしている。

内田弁護士によると、たとえば「40歳独身男性の購買傾向」のように、ビッグデータを加工・分析して、特定の個人を特定できない情報に抽象化すれば、個人情報には該当しなくなるという。

(弁護士ドットコム「企業が注目する「ビッグデータ」活用法「個人情報保護」は大丈夫か?」より 2013/04/24 14:50)

法的な問題は問われなかったものの、JR東日本は結果的に、利用者の反感を招いてしまった。もはや「個人を特定しない」という適法性ではなく、「許可なしで第三者に渡っている」「監視されている」「プロファイリングされている」という、プライバシーに関する心理的なストレス、消費者感情が問題の焦点になっているのだ。

■ビッグデータ収集、利用者の感情がカギに

Suica問題に限らず、個人情報保護法上で問題はなくとも、プライバシーや利用者感情が懸念される事例は後を絶たない。

2012年、ベンチャー企業の「ミログ」のスマホアプリが、利用情報や端末IDを自動的に同社のサーバーに送信していることが発覚し、会社解散に追い込まれた。法的な問題を指摘する声もあったが、結果的には法的問題には発展せず、「社会的信用を失った」という点が解散の直接の理由になった。

2011年に公開したアプリに、ユーザーの同意を得る前にデータを収集、送信してしまうなどの致命的な瑕疵がありました。このため、ミログの社会的信用を失墜させてしまいました。

事業の核である社会的信用が大きく傷ついた以上、同じ領域での事業再開は難しい、と判断しました。また、この事業で大きな資本を調達しているため、事業の大幅な変更は信義則に反します。

(ITpro「インタビュー - なぜミログは解散に至ったのか、城口代表に聞く---ミログ 代表取締役 城口 洋平氏」より 2013/04/13)

このほかにも、佐賀県武雄市の図書館が、TSUTAYAのTカードを導入したことについて批判が起こったことも記憶に新しい。プライバシーについての懸念が表明される中、武雄市長はあくまで適法であることを訴えている。

こうした例に見るように、ビッグデータにまつわるプライバシーは、個人情報保護法の枠組みだけでは解決できない。日本の法律では「プライバシー」が定義されておらず、制度面が実態に追いついていないのが現状だ。

■そのビッグデータは本当に個人を特定しないのか

ここまでの事例はいずれも、「特定個人を識別しない」としている点が、批判を受けつつも法的な問題にいたらなかった最大の根拠になっている。だが、本当に「適切に処理されたビッグデータ」は特定個人を識別しないのか。外国の事例を見てみよう。

米国のネットビデオレンタル大手のNetflixは、会員ごとにおすすめの映画を表示する機能の精度を上げるため、賞金を出してアルゴリズムを改善するコンテストを開催。このコンテストのために、匿名化された貸出履歴のデータを参加者に提供した。2008年、この貸出履歴データと映画データベースサイト「Internet Movie Database」の書き込み情報を照らし合わせると、一部の利用者の特定が可能になる論文が発表された。これを受けてNetflixはプライバシーの侵害を理由に訴訟を起こされている(後に和解)。匿名化されたはずのデータが、インターネットで誰でも見られるデータと組み合わせることで個人を特定できてしまった(WIRED「NetFlix Cancels Recommendation Contest After Privacy Lawsuit」より。 2010/03/12 14:48)。

これだけではない。今年1月には、匿名のDNAとインターネット上の情報を突き合わせて、個人を特定した研究がアメリカで発表された。DNAは研究用に世界中から匿名で集められたもので、年齢と住んでる地域の情報が記録されていた。この情報とネットの情報を付きあわせて、1000人分のうち50人分が家系図にたどり着き、特定できたという(BBC News「Donated genetic data 'privacy risk'」より。 2013/01/18 04:29 ET)。

仮にビッグデータから個人を特定しなくても、利用者の心情次第で行動が変わる事例も、アメリカの小売大手Targetの事例がニューヨーク・タイムズで紹介されている。

Targetは購買データ分析によって、女性が妊娠したことを場合によっては「本人より早く察知」する。妊娠初期の女性はマグネシウム、カルシウム、亜鉛のサプリメントや、無香性の化粧水を購入する傾向にあるというのだ。だがTargetは、妊娠を察知したからといってすぐにクーポンを送りつけても効果がないことを悟る。そこで、おむつや幼児服のクーポンを、妊婦が買わなさそうなワイングラスや芝刈り機のクーポンと混ぜて送ると、利用率が上がることがわかった(New York Times「How Companies Learn Your Secrets」より。 2012/02/16)。

つまり、ニーズに合ったクーポンであっても「監視されている」と思うと買わなくなってしまうというわけだ。

■日本で導入予定「プライバシー・コミッショナー制度」とは?

ここまで見たきたように、ビッグデータを取り巻くプライバシーの実態は、現行の法制度では対応できない。こうした状況を受けて日本はEUやアメリカにならい、総務省が音頭を取って制度化に動き始めている。総務省の研究会が5月20日に報告書を提出し、基本的な方針を明らかにした。

ここでは、ネットやスマホ時代を前提にしたプライバシー制度の構築、国際協調などが盛り込まれているが、目玉になるのは「プライバシー・コミッショナー制度」と呼ばれる、第三者機関の設立だ。この機関ではさまざまな分野の識者を横断的に集め、個人に関わる情報についてグレーゾーンの案件をルールに則って処理していく。

日本以外の多くの先進国では、このようなプライバシーコミッショナー制度が始まっており、国際間の問題の整理にはプライバシーコミッショナーが当たっているという。日本は、国際協調の面でも出遅れている。

プライバシーコミッショナー制度によって、これまで法的なグレーだった部分に明確な判断基準が生まれることで、大企業ほど過剰に自主規制してきた個人情報の幅広い活用が進み始める可能性もある。

(ITpro「法制度面から見たビッグデータ時代のプライバシー問題」より 2012/05/08)

総務省は2013年度内に制度面を固め、第三者機関の設置の検討を進めるとしている。ビッグデータとプライバシーを取り巻く環境は、ここ1〜2年で一気に変わっていきそうだ。

※ビッグデータ時代のプライバシーについて、どのようなルールがあるべきでしょうか。皆さんの考えをお聞かせください。